Ультразвуковой контроль (УЗК) — Аттестационный центр «НАКС-Иваново»

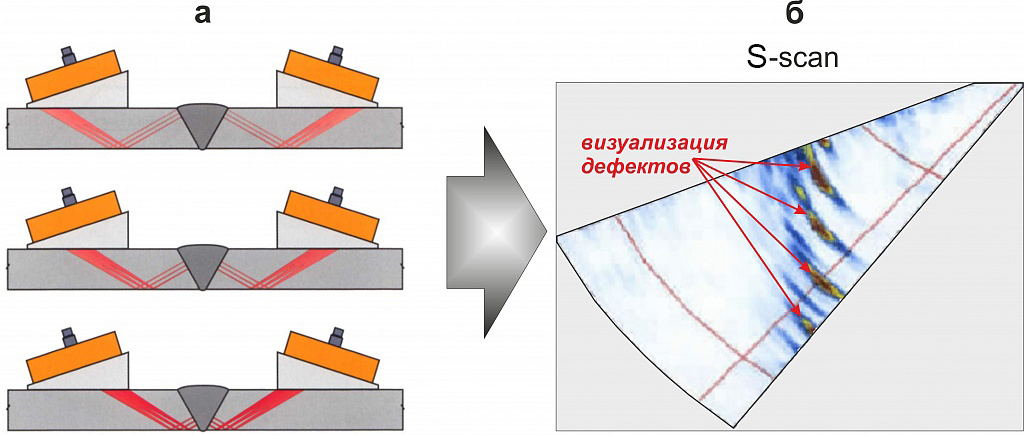

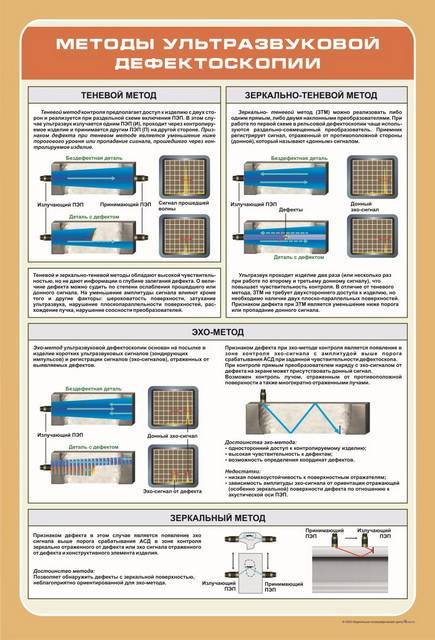

Лаборатория НАКС-Иваново осуществляет работу по ультразвуковому контролю — одному из самых популярных методов неразрушающего контроля, использующему для выявления дефектов материалов и сварных швов ультразвуковые волны путём излучения и принятия ультразвуковых колебаний, отраженных от внутренних несплошностей (дефектов) с дальнейшим анализом их амплитуды, времени прихода, формы и других характеристик с помощью специального оборудования — ультразвукового дефектоскопа.

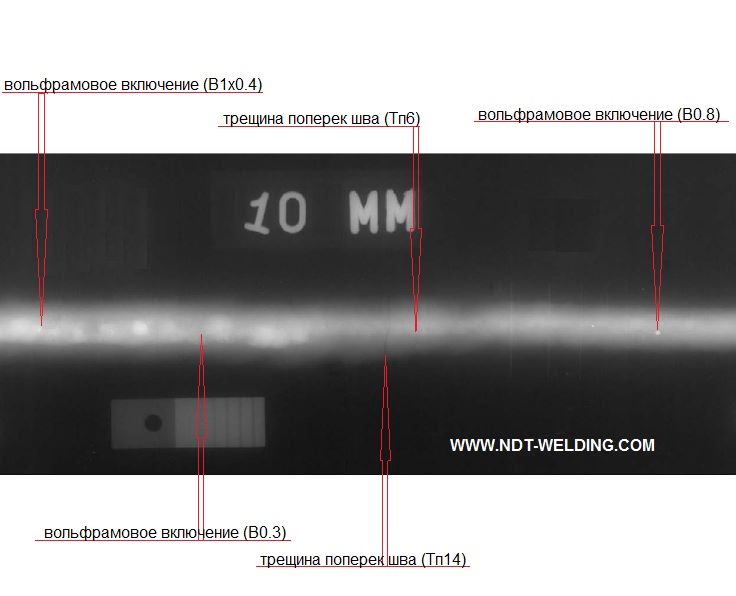

Ультразвуковой контроль предназначен для выявления в сварных швах и околошовной зоне трещин, непроваров, несплавлений, пор, шлаковых включений, расслоений и других видов дефектов без расшифровки их характера, но с указанием координат, условных размеров и количества обнаруженных дефектов.

Ультразвуковое исследование не разрушает и не повреждает исследуемый образец, что является его главным преимуществом. Можно проводить контроль изделий из разнообразных материалов, как металлов, так и неметаллов.

Ультразвуковой контроль сварных швов

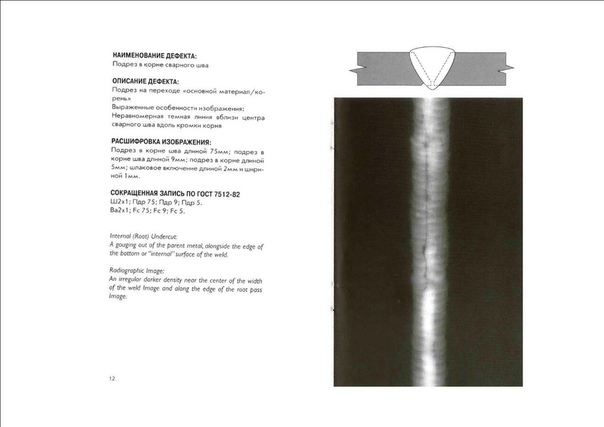

Сварные швы являются самой массовой областью применения ультразвуковой дефектоскопии. Это достигается за счёт мобильности ультразвуковой установки, высокой производительности контроля, высокой точности, высокой чувствительности к любым внутренним (объёмным — поры, металлические и неметаллические включения; плоскостным — непровары, трещины), а также внешним, т.е. поверхностным дефектам сварных швов (подрезы, несоответствия валика усиления и т.п.).

Многие ведомственные документы подразумевают обязательный ультразвуковой контроль сварных швов, либо альтернативный выбор ультразвукового или радиационного контроля, либо контроль обоими методами.

Ультразвуковой контроль сварных соединений является эффективным способом выявления дефектов сварных швов и металлических изделий, залегающих на глубинах от 1-2 миллиметров до 6-10 метров.

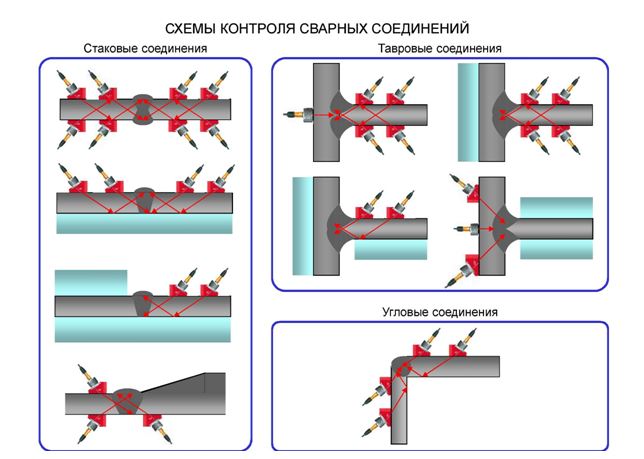

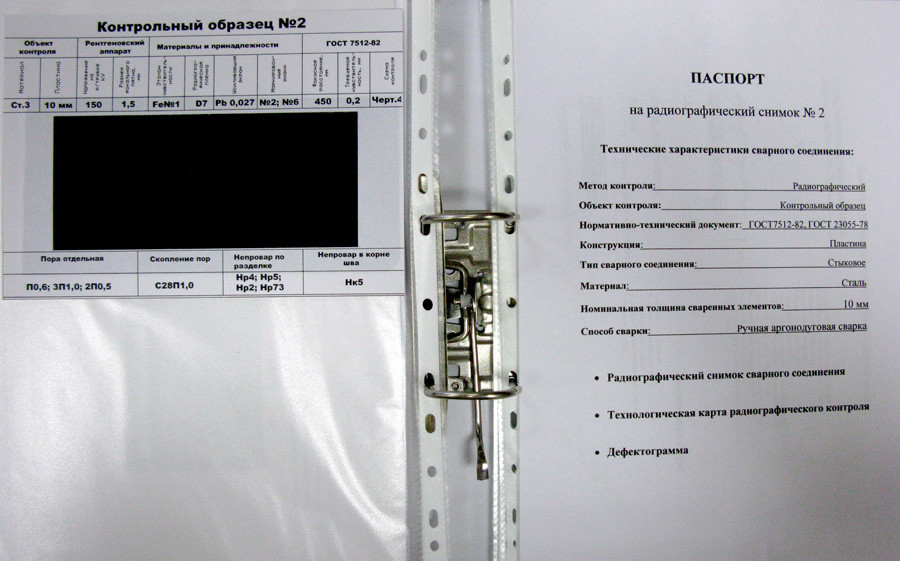

Ультразвуковой контроль сварных соединений проводится по ГОСТ 14782-86 «Контроль неразрушающий. Соединения сварные. Методы ультразвуковые» и позволяет осуществлять ультразвуковую диагностику качества сварных соединений, выявлять и документировать участки повышенного содержания дефектов, классифицируя их по типам и размерам. Для разных типов сварных соединений применяются соответствующие методики ультразвукового контроля.

Ультразвуковой контроль сварных соединений позволяет провести полную диагностику сварных соединений без использования дорогостоящих методов неразрушающего контроля качества сварных швов, таких как рентгенографический, гаммаграфический, магнитопорошковый или капиллярный.

| Лидеры продаж УКШаблон Красовского УШК-1 Эталоны чувствительности канавочные Магнитный прижим П-образный Термометр testo 905-T2

|

Что такое ОЗК, расшифровка и порядок одевания защитного костюма

ОЗК расшифровывается как «общевойсковой защитный костюм», он разработан в 1984 году и активно эксплуатируется по нынешний день.

ОЗК обладает высоким уровнем защиты от радиационной пыли, биохимического оружия. В то же время позволяет сохранить достаточно высокую мобильность носителя костюма.

Использование таких костюмов актуально во времена, когда ведётся борьба с короновирусом. Для дезинфекции необходимо пользоваться услугами специально обученных людей, которые проведут дезинфекцию дезинфицирующими средствами широкого спектра действия, но безвредными для человека и животных. Через 5 минут после дезинфекции вы можете пользоваться помещением.

Для дезинфекции необходимо пользоваться услугами специально обученных людей, которые проведут дезинфекцию дезинфицирующими средствами широкого спектра действия, но безвредными для человека и животных. Через 5 минут после дезинфекции вы можете пользоваться помещением.

Обыкновенно ОЗК носится с каким-либо СИЗОД (средством индивидуальной защиты органов дыхания) — например, противогазом.

Далее в статье вы узнаете что такое ОЗК, что входит в комплект и как расшифровывается, как правильно его надевать и каково предназначение общевойскового защитного комплекта в армии, промышленности и других сферах.

Назначение костюма

ОЗК — комплексный общевойсковой защитный костюм, обеспечивающий высокую степень индивидуальной защиты от радиации и биохимических факторов, сохранность дыхательных путей и кожи человека, а также его снаряжения, одежды, оружия и прочей экипировки.

В случае заблаговременной экипировки ОЗК действие отрицательных факторов на снаряжение ослабляется, также повышается уровень защиты дыхательных путей и кожи носителя.

Сферы применения общевойскового защитного комплекта

Можно выделить четыре основные сферы использования, в порядке убывания это:

- Вооружённые силы Российской Федерации: снаряжение личного состава для проведения операций на загрязнённой или потенциально загрязнённой территории.

- Рыбалка, реже охота, некоторые виды любительского туризма: превосходная защита от дождя, грязи, повышенной влажности.

- Заводы, лаборатории и промышленные предприятия: снаряжение для собственных специалистов на случай необходимости ликвидации последствий химической или биологической аварии.

- Некоторые милитаризованные игры — страйкбол, хардбол, лазертаг и им подобные.

Помимо этого ОЗК (расшифровка — общевойсковой защитный комплект) может использоваться для фотосессий, тематического декора помещений и во многих иных сферах, но значительно реже. ОЗК популярен среди гражданского населения (особенно в России и некоторых странах ближнего зарубежья) благодаря своей водонепроницаемости и долговечности.

Устройство, размеры, варианты комплектации

Из чего состоит защитный костюм ОЗК и какие виды химзащиты бывают? В состав ОЗК входят плащ, перчатки, чулки, чехол/чехлы для всего комплекта или же компонентов по отдельности, а также детали, способствующие более плотному прилеганию костюма к телу. Реже ОЗК дополнительно укомплектовывается пилоткой с козырьками и наушниками.

Подробнее о каждом элементе:

- Плащ производят из специально разработанного прорезиненного материала, который защищает от различных вредных воздействий (радиация, бактериологические и химические вещества). Застёгивается на шпеньки.Манжеты рукавов на резинке, капюшон регулируется кулиской. Есть карман для хранения запасных деталей, он расположен на рукаве, слева. Плащ оснащён дополнительными застёжками, с помощью которых модифицируется в комбинезон.Размер плаща подбирается под рост человека.Таблица соотношения ростовки и размера:

Рост, см Размер До 165 1 От 166 до 170 2 От 171 до 175 3 От 176 до 180 4 От 181 5 Масса плаща чуть больше полутора килограммов.

- Чехол изготавливается из обычной ткани без добавления резины. Он используется как для хранения комплекта, так и для оперативного надевания — плащ можно носить под чехлом как заспинный рюкзак, а по специальной команде распустить лямки, не снимая конструкцию. Скатанный плащ расправится, и останется только надеть рукава и застегнуться.

- Перчатки-краги исполнены из того же прорезиненного материала. Выпускается в двух вариантах — летнем БЛ-1М и зимнем Б3-1М. У летних перчаток по пять пальцев, у зимних — три (для большого и указательного отдельные, для остальных трёх пальцев общее).

Зимний вариант утеплён изнутри, утепляющие вкладыши вынимаются. Перчатки-краги в положении «наготове» хранят в тканевом чехле и носят на поясе. Перчатки (и зимние, и летние) имеют общий размер. Масса одной пары перчаток — около 350 граммов. - Защитные чулки из прорезиненного материала. Надеваются прямо на обувь. Крепятся к поясному ремню, фиксируются несколькими закрепками на стопе.

Подошва выполнена из другого материала, обладающего теми же защитными свойствами, но более прочного. В набор защитных чулок входят сами чулки, 6 шпеньков и 2 прорезиненные ленты для крепления на пояс.Размерный ряд чулок:

Подошва выполнена из другого материала, обладающего теми же защитными свойствами, но более прочного. В набор защитных чулок входят сами чулки, 6 шпеньков и 2 прорезиненные ленты для крепления на пояс.Размерный ряд чулок:Размер обуви Размер чулок 37-40 1 41-42 2 43 и более 3 Масса пары чулок 0,9— 1,3 кг.

- Пилотка — не обязательный компонент. Представляет собой шапку из прорезиненного материала с удлинёнными деталями в области ушей для их защиты, козырьком спереди и козырьком сзади для прикрытия шеи.

Как определить качество и отсутствие брака при покупке

Для того, чтобы выбрать качественный ОЗК, необходимо провести тщательную визуальную проверку всего устройства.

Стоит обратить особое внимание на места стыков деталей плаща, рукавов, проверить наличие всех шпеньков, тесёмок, а также целостность хлястиков.

Наличие талька на внешней стороне плаща говорит либо о его новизне, либо о повторной обработке тальком. Следует присмотреться к местам продевания шпеньков — если они разработаны и легко пропускают шпенёк, то этот комбинезон неоднократно использовался.

Предлагаем посмотреть еще фото защитного костюма ОЗК:

Как правильно одевать (видео), норматив надевания

По инструкции, военные обязаны надевать костюм в двух случаях:

- по команде «Газы!»;

- по собственной инициативе при обнаружении признаков заражения территории того или иного типа.

Смотрите видео о том, как правильно одеть ОЗК (костюм химической и биологической защиты):

Порядок одевания ОЗК:

- Чулки: надеть поверх собственной обуви, прикрепить к ремню, потуже зафиксировать на голенях.

- Непосредственно плащ: накидывается вместе с рукавами, застёгивается.

- Противогаз: в соответствии с правилами надевания противогаза.

- Капюшон плаща и/или защитная пилотка: козырьки и «наушники» пилотки должны быть направлены вниз, капюшон фиксируется кулиской.

- Перчатки: надеть на руки, спрятать манжеты перчаток под рукава.

Нормативы одевания ОЗК (время и оценка):

| Затраченное время, мин:сек | Оценка |

| 4:00 | Отлично |

| 4:20 | Хорошо |

| 5:00 | Удовлетворительно |

Снятие костюма возможно только в том случае, если достоверно установлено отсутствие опасности для человека — либо это незаражённая территория, либо очищенная территория, отсутствие опасности которой подтверждено приборами.

Долгое ношение оказывает утомительное воздействие на организм, в связи с этим необходимо не носить их дольше времени, предписанного нормативами.

В зависимости от температуры окружающей среды это может быть как 16 минут максимум (при температуре выше 30°С), так и более 3 часов (при температуре ниже 14°С).

При пасмурной погоде, а так же в тени ОЗК можно носить в полтора раза дольше.

Если вам интересно узнать о видах и функциях костюма пескоструйщика, предлагаем прочитать об этом в отдельной статье.На что следует обратить внимание при выборе одноразового комбинезона Каспер, мы расскажем здесь.

А о назначении и сферах применения костюма для защиты от повышенных температур читайте тут.

Правила хранения

Следует помнить, что малейшее нарушение целостности любой части комплекта ОЗК может повлечь за собой тяжёлые для носителя последствия.

Поэтому рекомендуется хранить костюм в специальном тканевом чехле, без лишней надобности не разворачивать.

После долгого хранения, но перед применением следует визуально оценить целостность плаща, перчаток, чулок, наличие и работоспособность шпеньков, тесёмок, закрепок.

Проверить размеры костюма, заменить на более подходящий комплект при необходимости.

ОЗК можно использовать многократно, но после каждого столкновения с радиоактивным и биохимическим воздействием необходима специальная обработка.

ОЗК — надёжный и достаточно универсальный инструмент для защиты человека от ряда опасных факторов окружающей среды антропогенного происхождения.Как и любой качественный инструмент, он будет служить долго и надёжно только в том случае, если тщательно соблюдать правила эксплуатации и хранения, которые в случае с ОЗК совершенно не сложные.

8.2 DGS/AVG (АРД-диаграммы) | Olympus IMS

АРД-диаграммы

АРД-диаграммы – метод определения размеров дефектов путем сравнения амплитуды эхо-сигнала от отражателя с амплитудой эхо-сигнала от плоскодонного отверстия, расположенного на той же глубине или расстоянии. Это известно как Эквивалентный размер отражателя или ERS. Аббревиатура АРД (DGS – Distance/Gain/Size) означает «амплитуда/расстояние/диаметр», также известно как AVG (с немецкого Abstand Verstarkung Grosse). Данная техника очень долго сводилась к механическому сравнению амплитуд эхо-сигналов с отображенными кривыми. Современные цифровые дефектоскопы позволяют изображать кривые с учетом процедуры калибровки и автоматически вычислять ERS максимума в стробе. Кривые выводятся из полученной схемы рассеяния пучка данного преобразователя, на основе частоты ПЭП и диаметра элемента с использованием одной точки калибровки. Можно учитывать затухание в материале и особенности акустического контакта калибровочного и контрольного образцов. АРД – является изначально математическим методом, основанным на отношении профиля луча круглого ПЭП и измеряемых свойств материала к круглым дисковым отражателям. С тех пор, данный метод был применен к квадратным элементам и даже раздельно-совмещенным ПЭП; в последнем случае конфигурация кривых задается эмпирическим путем. Пользователь должен сам определить, насколько полученные результаты АРД сопоставимы с реальными дефектами в объекте контроля.

Данная техника очень долго сводилась к механическому сравнению амплитуд эхо-сигналов с отображенными кривыми. Современные цифровые дефектоскопы позволяют изображать кривые с учетом процедуры калибровки и автоматически вычислять ERS максимума в стробе. Кривые выводятся из полученной схемы рассеяния пучка данного преобразователя, на основе частоты ПЭП и диаметра элемента с использованием одной точки калибровки. Можно учитывать затухание в материале и особенности акустического контакта калибровочного и контрольного образцов. АРД – является изначально математическим методом, основанным на отношении профиля луча круглого ПЭП и измеряемых свойств материала к круглым дисковым отражателям. С тех пор, данный метод был применен к квадратным элементам и даже раздельно-совмещенным ПЭП; в последнем случае конфигурация кривых задается эмпирическим путем. Пользователь должен сам определить, насколько полученные результаты АРД сопоставимы с реальными дефектами в объекте контроля.

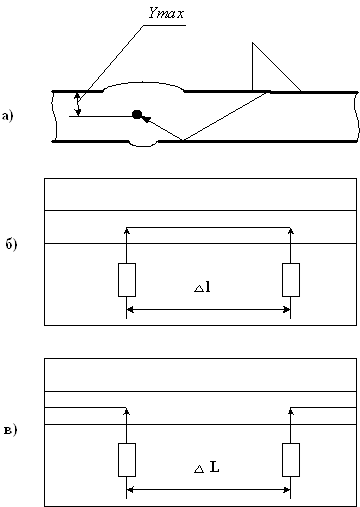

Пример типичной кривой АРД представлен ниже. Самая верхняя кривая представляет относительную амплитуду эхо-сигнала, исходящего от плоского отражателя (в дБ), на разном расстоянии от преобразователя; кривые ниже представляют относительную амплитуду эхо-сигналов, исходящих от все более маленьких дисковых отражателей, на одной шкале расстояний.

Самая верхняя кривая представляет относительную амплитуду эхо-сигнала, исходящего от плоского отражателя (в дБ), на разном расстоянии от преобразователя; кривые ниже представляют относительную амплитуду эхо-сигналов, исходящих от все более маленьких дисковых отражателей, на одной шкале расстояний.

В современных цифровых дефектоскопах, АРД-диаграммы обычно строятся на основе опорной калибровки известного элемента, например донного отражателя или плоскодонного отверстия на заданной глубине. С помощью этой точки калибровки можно построить всю кривую, с учетом характеристик ПЭП и свойств материала. Вместо изображения всей серии кривых, прибор обычно отображает одну кривую на основе размера выбранного отражателя (порог выявляемости). На приведенном ниже примере, верхняя кривая представляет график АРД для дискового отражателя 2 мм на глубине от 10 до 50 мм. Нижняя кривая – опорная кривая, построенная на 6 дБ ниже. На экране слева, красный строб обозначает отражение от плоскодонного отверстия диаметром 2 мм на глубине 20 мм. Поскольку отражатель равен выбранному уровню выявляемости, максимум сигнала соответствует кривой на данной глубине. На экране справа, в стробе, расположен другой отражатель на глубине примерно 26 мм. На основе высоты и глубины залегания отражателя по отношению к кривой, прибор вычислил ERS 1,5 мм.

Поскольку отражатель равен выбранному уровню выявляемости, максимум сигнала соответствует кривой на данной глубине. На экране справа, в стробе, расположен другой отражатель на глубине примерно 26 мм. На основе высоты и глубины залегания отражателя по отношению к кривой, прибор вычислил ERS 1,5 мм.

NSW (П411) Прямые ПЭП поперечных волн

| Внешний вид преобразователей NSW (П411) |

Направление поляризации поперечных ультразвуковых волн |

Габаритные размеры |

Прямые контактные преобразователи поперечных волн, тип NSW(П411), содержат специальные пъезоэлементы, создающие сдвиговые колебания. Эти преобразователи генерируют и принимают линейно поляризованные поперечны волны бегущие перпендикулярно поверхности ввода.

Расшифровка обозначения NSW — Normal (Incidence) Shear Wave (Transducer), затем следует частота ультразвуковых колебаний (МГц). В скобках указано российское обозначение ПЭП -П411.

Для ввода поперечных волн в изделия не подходят обычные контактные жидкости. Необходимо использовать специальную очень вязкую контактную пасту «Миасс-ПК» обладающую высоким коэффициентом передачи сдвиговых колебаний.

Обычно преобразователи NSW(П411) применяют для измерения скорости поперечных волн в материалах. В дальнейшем значении скорости поперечной волны используют для расчета модуля сдвига.

Преобразователи NSW (П411) являются импортозамещающими аналогами известных ПЭП фирмы Olympus серии V150-V157 и V220-V222.

Технические характеристики

| Наименование преобразователя |

Частота (МГц) |

Условная чувствительность по донному эхосигналу в мере СО-2, не менее (дБ) [1] |

Длительность РШХ, не более (мкс) [2] |

Длительность эхосигнала, не более (мкс) [3] |

| NSW-1,0 (П411-1,0) | 1,0 | 40 | 38 | 3,0 |

| NSW-1,25 (П411-1,25) | 1,25 | 40 | 38 | 3,0 |

| NSW-2,0 (П411-2,0) | 2,0 | 30 | 34 | 2,0 |

| NSW-2,5 (П411-2,5) | 2,5 | 20 | 28 | 1,5 |

| NSW-4,0 (П411-4,0) | 4,0 | 15 | 18 | 1,0 |

| NSW-5,0 (П411-5,0) | 5,0 | 12 | 17 | 0,8 |

Примечания:

В таблице указаны значения технических параметров измеренных с помощью дефектоскопа УД9812.

[1] Условную чувствительность находят как запас усиления дефектоскопа (дБ) при настройке по донному эхосигналу в мере СО-2 (высота 59мм).

[2] Длительность РШХ (реверберационно-шумовая характерстика) определяют на уровне условной чувствительности, см. примечание [1]

[3] Длительность эхосигнала определяют на уровне -6дБ от его максимума.

Примеры применения

| Прозвучивание меры СО-2. Преобразователь NSW-5,0 (П411-5,0) | Донный эхосигнал поперечных волн в мере СО-2. Преобразователь NSW-2,5 (П411-2,5) |

| Прозвучивание стального образца толщиной 30мм. Преобразователь NSW-2,5 (П411-2,5) | Донные эхосигналы поперечных волн в стальном образце 30мм. Преобразователь NSW-2,5 (П411-2,5) |

«Центраскан» с композитным излучателем

|

|||||||||

Ультразвуковые преобразователи к дефектоскопам УД2-70, ПЕЛЕНГ-115 и УД2-12

|

|||||||||

Стандартные образцы ультразвукового контроля CO 2, CO 3, CO 3P

|

|||||||||

Наклонные ультразвуковые преобразователи к дефектоскопам А1212 МАСТЕР ЛАЙТ, А1212 МАСТЕР ПРОФИ, А1214 ЭКСПЕРТ

|

|||||||||

Раздельно-совмещенные ультразвуковые преобразователи к дефектоскопам А1212 МАСТЕР ЛАЙТ, А1212 МАСТЕР ПРОФИ, А1214 ЭКСПЕРТ, А1209

|

|||||||||

Совмещенные ультразвуковые преобразователи к дефектоскопам А1212 МАСТЕР ЛАЙТ, А1212 МАСТЕР ПРОФИ, А1214 ЭКСПЕРТ, А1209

|

|||||||||

Низкочастотные преобразователи к дефектоскопу А1220 МОНОЛИТ

|

|||||||||

Стандартные образцы предприятия

|

|||||||||

Датчики и аксессуары для высокоточных (прецизионных) толщиномеров и дефектоскопов Olimpus

|

|||||||||

Ультразвуковые преобразователи П112

|

|||||||||

Эталонный образец (мера) СО-2

|

|||||||||

Эталонный образец (мера) СО-3

|

|||||||||

Эталонный образец (мера) СО-3Р

|

|||||||||

Стандартный образец СО-1

|

|||||||||

Эталонный образец (мера) V1

|

|||||||||

Эталонный образец (мера) V2

|

|||||||||

Плоские и трубные настроечные образцы

|

|||||||||

Стандартные образцы для ультразвуковой толщинометриии

|

|||||||||

Контрольные образцы для определения характеристик ПЭП при контроле объектов атомной энергетики

|

|||||||||

Комплект мер толщины МЭТ-300

|

|||||||||

Комплект образцов КМД4-0

|

|||||||||

Меры твердости МТБ-1

|

|||||||||

Меры твердости МТР-1

|

|||||||||

Меры твердости МТВ-1

|

|||||||||

Меры твердости МТСР-1

|

|||||||||

УЗК-Э-СП-11 на тележке | Ланфор

УЗК — устройство заготовки кабельных каналов, предназначено для облегчения процесса протягивания (прокладки) кабеля, провода в кабельной канализации, межэтажных конструкциях, трубах, кабельных стояках, кабель каналах и т.д.

УЗК-Э-СП – это УЗК с силовым элементом из полностью диэлектрического стеклопластикого прутка покрытого полиэтиленовой защитной оболочкой (далее стеклопруток), на концах которого закреплены стальные оцинкованные наконечники с навинчивающимися насадками для заготовки канала и крепления кабеля (провода, веревки и т. д.) к прутку при протягивании.

д.) к прутку при протягивании.

Полиэтиленовое покрытие УЗК защищает стеклопруток от расслоения (разрушения) и снижает трение, значительно облегчая тем самым протяжку УЗК в кабельной канализации, межэтажных конструкциях, трубах, кабельных стояках, кабель каналах и т.д.

Транспортировочная тележка с разматывающим устройством ТТ-500 — представляет собой каркас, на оси которого крепиться кассета с прутком в защитном полимерном покрытии. На каркасе тележки также закреплены направляющие, через которые пропускают стеклопруток при работе с УЗК. ТТ-500 имеет два металлических колеса с прорезиненным покрытием для перемещения на рабочем месте. Емкость кассеты ТТ-500 — 500 метров стеклопрутка D=11 mm.

Особенности ТТ-500:

- Прочные металлические колеса с прорезиненными катками.

- Простая система замены кассеты.

- Оптимальный баланс надежности конструкции, размеров и веса.

- Удобная транспортабельность тележки.

Расшифровка маркировки УЗК-Э-СП-11/X:

УЗК — устройство заготовки кабельных каналов (протяжка, кабельный кондуктор, буш).

Э — устройство серии «ЭКОНОМ» (стеклопруток производства России)

СП — силовой элемент — стеклопластиковый пруток

11 — диаметр силового элемента в полимерной оболочке 11мм, допустимые отклонения от -0.2мм до +0.5мм

X — длина силового элемента от 50 до 500 метров, допустимые отклонения от -0.1м до +0.5м.

Наш менеджер свяжется с вами в ближайшее время

Декодирование алгебраических списков с оптимальной скоростью с использованием узких полей классов лучей

Abstract

Мы используем теорию полей классов, в частности модули Дринфельда ранга 1, для построения семейства асимптотически хороших алгебро-геометрических (AG) кодов над фиксированными алфавитами. В поле размера 2 эти коды находятся в пределах 2 / (ℓ − 1) от границы Синглтона. Поля функций, лежащие в основе этих кодов, являются подполями с циклической группой Галуа поля классов узких лучей определенных функциональных полей. Полученные коды «сворачиваются» с помощью генератора группы Галуа.Это обобщает более раннюю работу первого автора по свернутым кодам AG, основанным на полях циклотомических функций. Используя теорему Чеботарева о плотности, мы доказываем наличие большого количества инертных мест большой степени в нашем циклическом расширении и используем это для разработки линейно-алгебраического алгоритма для перечисления этих свернутых кодов с точностью до доли ошибок, приближающейся к 1-R, где R это ставка. Декодирование списка может выполняться за полиномиальное время с учетом полиномиального количества предварительно обработанной информации о поле функции.

Поля функций, лежащие в основе этих кодов, являются подполями с циклической группой Галуа поля классов узких лучей определенных функциональных полей. Полученные коды «сворачиваются» с помощью генератора группы Галуа.Это обобщает более раннюю работу первого автора по свернутым кодам AG, основанным на полях циклотомических функций. Используя теорему Чеботарева о плотности, мы доказываем наличие большого количества инертных мест большой степени в нашем циклическом расширении и используем это для разработки линейно-алгебраического алгоритма для перечисления этих свернутых кодов с точностью до доли ошибок, приближающейся к 1-R, где R это ставка. Декодирование списка может выполняться за полиномиальное время с учетом полиномиального количества предварительно обработанной информации о поле функции.

Наша конструкция дает алгебраические коды над алфавитами постоянного размера, которые могут быть декодированы по списку с точностью до границы Синглтона — в частности, для любой желаемой скорости R∈ (0,1) и константы ε> 0 мы получаем коды с размером алфавита ( 1 / ε) O (1 / ε2), которые могут быть декодированы по списку с точностью до доли ошибок 1-R-ε, ограничивая соседние сообщения подпространством с NO (1 / ε2) элементами. Предыдущие результаты декодирования списков с точностью до доли ошибок 1-R-ε по алфавитам постоянного размера были либо основаны на конкатенации, либо предполагали взятие тщательно отобранного подкода алгебро-геометрических кодов.Напротив, наш результат показывает, что эти свернутые алгебро-геометрические коды сами обладают заявленным свойством декодирования списков.

Предыдущие результаты декодирования списков с точностью до доли ошибок 1-R-ε по алфавитам постоянного размера были либо основаны на конкатенации, либо предполагали взятие тщательно отобранного подкода алгебро-геометрических кодов.Напротив, наш результат показывает, что эти свернутые алгебро-геометрические коды сами обладают заявленным свойством декодирования списков.

Ключевые слова

Свернутые коды

Автоморфизм

Поля классов

Теорема Чеботарева о плотности

Кодирование и декодирование

Рекомендуемые статьиЦитирующие статьи (0)

Просмотр аннотацииCopyright © 2014 Elsevier Inc. Все права защищены.

Рекомендуемые статьи

Цитирующие статьи

Метод декодирования на основе распознавания образов для отрицательного импульсного сигнала нисходящей линии связи с узкой шириной импульса

На рисунке 3 показана блок-схема принципа распознавания образов в этой статье.Ядро модели распознавания образов использует матрицу евклидовых расстояний метода ближайшего соседа в качестве дискриминантной функции для идентификации всех сегментов сигнала с аналогичными характеристиками формы сигнала.

Рис.3 Схемы художественного рисунка Принцип

распознаванияшаблона математическая модель

(1) Определить сегмент опорного сигнала. Опорный сегмент выбирается на первом сегменте спадающего фронта формы сигнала (также может быть выбран сегмент нарастающего фронта, в этой статье спадающий фронт используется в качестве объекта анализа), а в методе выбора может использоваться алгоритм начальной кластеризации k-средних Метод выбора центра, как правило, бывает «выбор на основе опыта», «случайный метод» и «метод плотности» (Xing and Xiao 2010).

Эта статья выбирает «метод плотности», чтобы определить сегмент опорного сигнала.

Если минимальная ширина импульса сигнала занимает 8 с \ (T _ {\ min} \), а частота дискретизации \ (F _ {{\ text {s}}} \) составляет 100 Гц, минимальное количество данных дискретизации точек \ (N \) для одной выборки равно 800. Чтобы полностью выразить характеристики формы сигнала спадающего фронта сигнала, время выборки \ (T_ {s} \) исследовательского сегмента должно быть выбрано так, чтобы составлять 10% -40% всего сегмента на заднем крае. {T}} $$

{T}} $$

(5)

В этой статье анализируются данные об амплитуде сигнала, чтобы найти сегменты заднего фронта сигнала с аналогичными характеристиками.\ (B_ {0} \) представляет собой отправную точку. Чтобы гарантировать точность модели, шаг алгоритма установлен на 1, а матрица разности \ (L_ {1} \) между амплитудами сигналов записывается как:

$$ L_ {1} = B_ {0} — b_ {i} $$

(6)

Среди них \ (b_ {i} \) — это сегмент сигнала, который непрерывно собирается во времени \ (T_ {s} \), а его последовательность данных — \ (b_ {i} = \ {x (T_ {0} + i), x (T_ {0} + 1 + i), \ ldots, x (T_ {0} + T_ {s} + i) \} \), \ (i = 1,2, \ ldots, n \) и \ (n \) — количество пройденных данных.{{T_ {0} + i}} {L _ {{1_ {j}}}}}} {{T_ {0}}} $$

(7)

Принимая матрицу разностей \ (L_ {1} \) (\ (L_ {1} = \ left \ {{\ begin {array} {* {20} c} {L_ {11}} & {L_ {12) }} & \ ldots & {L_ {1n}} \\ \ end {array}} \ right \} \)) двух сегментов сигнала, а средняя матрица разности (\ (L_ {2} \) является значение, которое может быть описано как матрица 1 × 1) в качестве матрицы выборки и эталонной матрицы в вышеупомянутой модели матрицы евклидовых расстояний. {T}} $$

{T}} $$

(8)

Последовательность матрицы \ (D \) выражается как \ (D = \ left \ {{\ begin {array} {* {20} c} {D_ {1}} & {D_ {2}} & \ ldots & {D_ {n}} \\ \ end {array}} \ right \} \), \ (D \) — это матрица размером 1 × \ (n \), которая представляет собой количество данных, которые могут быть пройдены .

Алгоритм декодирования

Используя элементы в матрице евклидовых расстояний \ (D \) в качестве функциональной кривой и кривой анализа, можно определить ее минимальные значения \ (T \), которые представляют собой начальную точку каждого подобного сегмента \ (T = \ {T_ {0}, T_ {1}, T_ {2}, \ ldots, Т_ {j} \} \), где элемент \ (Т_ {0} \) представляет собой начальную точку отрезка опорного сигнала .

Вычисление данных сегмента сигнала, представленных им как \ (B_ {1} \), \ (B_ {2} \), \ (\ ldots \), \ (B_ {j} \), и последовательность \ ( B_ {j} \) можно записать как:

$$ B_ {j} = [x (T_ {j} + 1), \; x (T_ {j} + 1 + 1), \ ldots, x ( T_ {j} + 1 + T_ {s})] $$

(9)

Среди них \ (j = 1, \; 2, \; \ ldots \ ;, k — 1 \), где \ (k \) представляет количество спадающих фронтов всей формы сигнала.

Для повышения точности определения начальной точки команды нисходящей линии связи в этой статье используется конкретная структура заголовка синхронизации для определения начальной точки кодированного сигнала нисходящей линии связи.Структура заголовка синхронизации должна существенно отличаться от передаваемых символов. Например, структура «8 с-8 с-20 с-8 с» может использоваться для длительности импульса 8 с. Заголовок синхронизации содержит два аналогичных сегмента, поэтому при декодировании сигнала нисходящей линии связи можно начать отсчет от аналогичного сегмента \ (B_ {2} \).

- (1)

Рассчитайте фактическую минимальную длительность импульса \ (T_ {A — \ min} \). В случае добавления сегмента сигнала заголовка синхронизации можно вычислить фактическую минимальную ширину импульса при искажении формы сигнала:

$$ T_ {A — \ min} = \ frac {{T_ {1} — T_ {0 }}} {2} $$

(10)

- (2)

Расшифровать соответствующее командное слово.

Фактическая минимальная ширина импульса может использоваться для определения кода инструкции между каждой шириной импульса. Во-первых, нахождение длительности интервала ширины импульса \ (\ Delta T \) каждого подобного сегмента:

Фактическая минимальная ширина импульса может использоваться для определения кода инструкции между каждой шириной импульса. Во-первых, нахождение длительности интервала ширины импульса \ (\ Delta T \) каждого подобного сегмента:$$ \ Delta T = \ left \ {{T_ {1} — T_ {0}, \; T_ {2} — T_ {1}, \ ldots, T_ {j} — T_ {j — 1}} \ right \} $$

(11)

Расчет целочисленного значения \ (q_ {j} \) фактической минимальной ширины импульса \ (T_ {A — \ min} \):

$$ q_ {j} = \ left [{\ frac {\ vartriangle T} {{T_ {A — \ min}}}} \ right] = \ left [{\ frac {{T_ {j} — T_ {j — 1}}} {{T_ {A — \ min}}}} } \ right] $$

(12)

Среди них \ (j = 1,2, \ ldots, k — 1 \).Удалите сегмент сигнала, занятый заголовком синхронизации, затем начните с промежуточной точки данных \ (x [\ frac {{(2T_ {v} + T_ {s} + 1)}} {2}] \) аналогичного сегмента \ (B_ {v} \) (\ (v = 2,3, \ ldots, k — 1 \)) и запишите его как новую последовательность данных \ (C_ {l} \) с длиной шага \ (T_ { A — \ min} \) последовательность данных \ (C_ {l} \) выглядит следующим образом:

$$ C_ {l} = x \ left [{\ frac {{(2T_ {i} + T_ {0 } + 1)}} {2} + l} \ right] $$

(13)

Среди них \ (l = 1,2, \ ldots, T_ {A — \ min} \), вычисляющее среднее значение последовательности как \ (c_ {w} \):

$$ c_ {w } = \ frac {{\ sum \ limits_ {l = 1} ^ {{T_ {A — \ min}}} {C_ {l}}}} {{T_ {A — \ min}}} $$

(14)

Среди них \ (w \) — количество командных слов (кодовых единиц). Присвойте значение элементу кода \ (M \) из \ (\ Delta T \), сравнив значение:

Присвойте значение элементу кода \ (M \) из \ (\ Delta T \), сравнив значение:

$$ M_ {w} = \ left \ {{\ begin {array} {* {20} c} {0, \; c_ {w} \ ge x [\ frac {{(2T_ {v} + T_ {s} + 1)}} {2}]} \\ {1, \; c_ {w} (15) Между тем необходимо удалить данные \ (x (\ Delta T — q_ {j} \ cdot T_ {A — \ min}) \). Конкретный процесс алгоритма декодирования командного слова показан на рис.4: для командного слова Размещение клеток в гиппокампе млекопитающих сигнализирует само-локализацию с разреженными пространственно стабильными полями возбуждения. На основании наблюдения за активностью клеток места можно точно расшифровать местонахождение животного. Возможность точной самоопределения критически важна для большинства подвижных организмов.У млекопитающих клетки места в гиппокампе, по-видимому, являются центральным компонентом сети мозга, ответственной за эту способность. В этой работе мы записали активность популяции нейронов гиппокампа от свободно перемещающихся грызунов и провели нейронное декодирование для определения местоположения животных. Мы обнаружили, что подход машинного обучения с использованием рекуррентных нейронных сетей (RNN) позволяет нам предсказать истинное положение грызунов более точно, чем стандартный байесовский метод с плоскими априорными значениями (т.е.е. оценка максимального правдоподобия, MLE), а также байесовский подход с памятью (то есть с априорными данными, полученными на основе прошлой активности). RNN могут учитывать прошлую нейронную активность, не делая предположений о статистике срабатывания нейронов. Кроме того, проанализировав репрезентации, полученные в сети, мы смогли определить, какие нейроны и какие аспекты их активности больше всего способствовали точному декодированию. Образец цитирования: Tampuu A, Matiisen T, lafsdóttir HF, Barry C, Vicente R (2019) Эффективное нейронное декодирование собственного местоположения с глубокой повторяющейся сетью.PLoS Comput Biol 15 (2):

e1006822.

https://doi.org/10.1371/journal.pcbi.1006822 Редактор: Франческо П. Батталья,